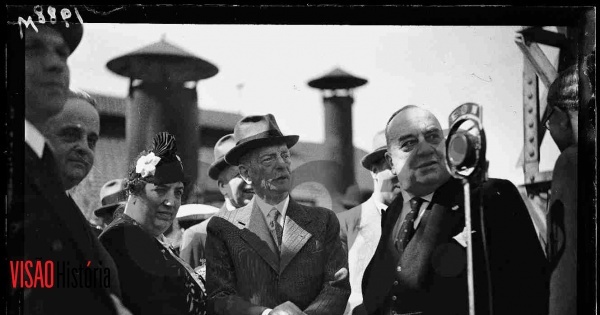

«Boa noite, meus compatriotas americanos. O destino decidiu que os homens que foram em paz explorar a Lua vão ficar na Lua a descansar em paz». Este foi o discurso preparado para o presidente americano Richard Nixon caso a missão Apollo 11, que tinha como objetivo colocar os primeiros humanos na Lua em 1969, tivesse corrido mal. Como a missão foi bem sucedida, este discurso nunca foi proferido – até agora.

Investigadores do Instituto de Tecnologia de Massachusetts (MIT), nos EUA, criaram um deepfake – vídeo criado por sistemas de inteligência artificial que mostra uma pessoa a dizer ou a fazer algo que nunca disse ou fez – no qual colocam o então presidente dos EUA a ler a versão “alternativa” do discurso.

O projeto foi criado como um trabalho artístico, para mostrar como é possível usar tecnologia moderna para criar uma versão alternativa de factos históricos. Os investigadores queriam saber «o que acontece se usarmos tecnologias deepfake para providenciar uma alternativa histórica, ao usar uma peça de arquivo real», explicou Francesca Panetta, uma das criadoras do projeto, em declarações à publicação Motherboard.

O resultado final foi conseguido com ajuda de duas empresas: Canny AI, que foi responsável por recolher vídeos de Richard Nixon para conseguir criar uma versão quase perfeita do discurso do presidente, à qual foi necessária juntar uma gravação em estúdio feita por um ator; e a Respeecher, uma empresa ucraniana que cria vozes sintéticas a partir de modelos de inteligência artificial.

O projeto, que foi mostrado no festival internacional de cinema de Amesterdão, na Holanda, serve também para mostrar o impacto que os deepfakes podem ter em áreas como a política e a disseminação de desinformação. A experiência feita pelo MIT mostra também como os deepfakes podem ser usados para alimentar teorias da conspiração, ao mostrar uma figura importante – neste caso o presidente dos EUA em 1969 – a dizer algo que nunca disse sobre algo que nunca aconteceu.

Segundo Hao Li, investigador e um dos pioneiro dos vídeos deepfakes, vídeos manipulados «perfeitamente reais» vão surgir já em 2020.