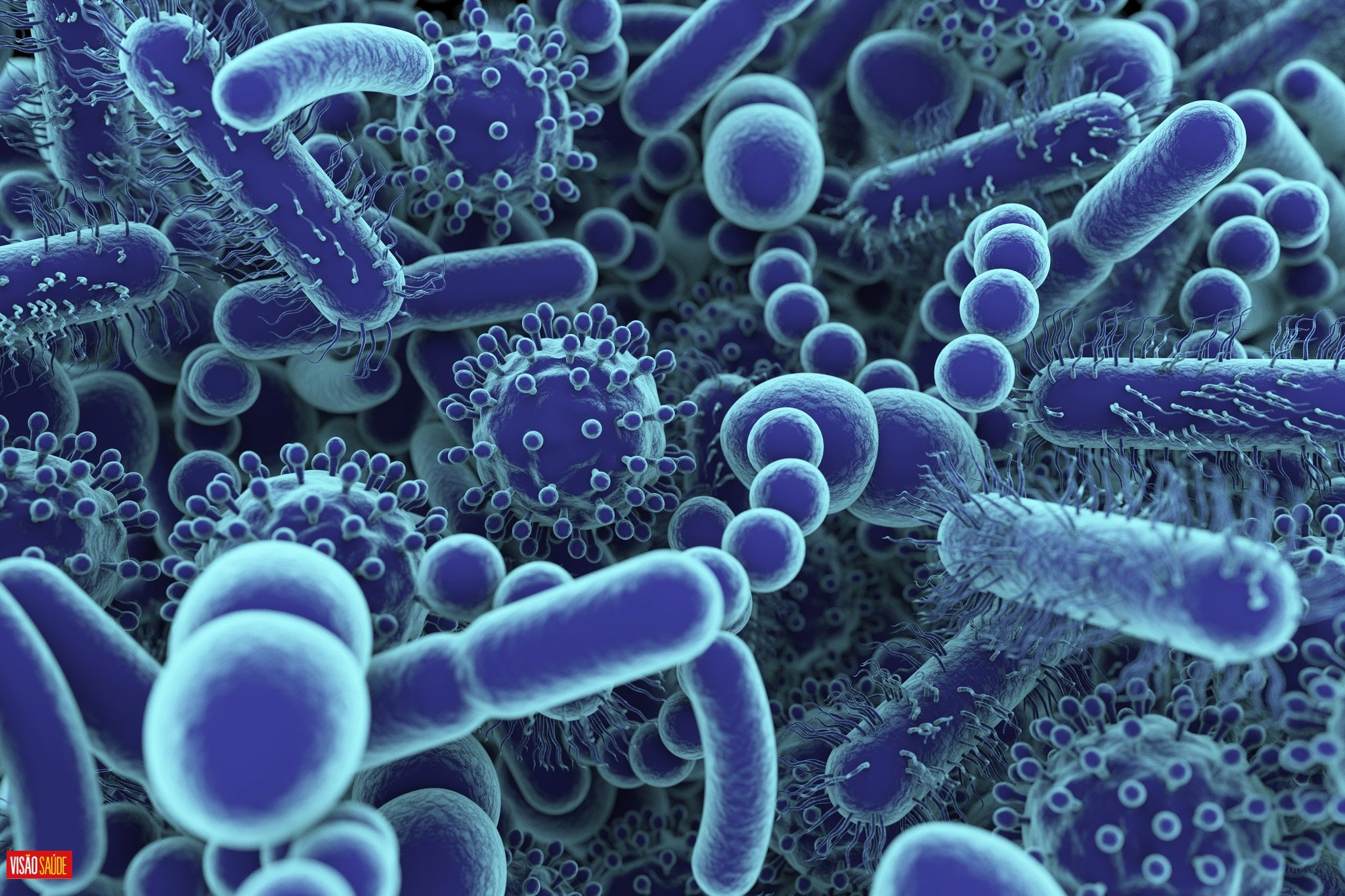

Mirai. WannaCry. NotPetya. Stuxnet. Se acompanha o mundo da segurança informática, então estes nomes são-lhe familiares e não pelos melhores motivos. Para o caso de não prestar tanta atenção a esta área, saiba que estes são alguns dos maiores, mais violentos e sofisticados ataques informáticos que acontecerem nos últimos anos. Há vários motivos que explicam cada um destes casos: desejos pessoais, sistemas operativos por atualizar, atacantes cada vez mais engenhosos e até interesses estatais. E o cenário promete piorar, com novas armas à disposição dos atacantes.

A empresa russa de cibersegurança Kaspersky realizou na semana passada, em Lisboa, um dos seus principais eventos anuais dedicados a tendências na área da cibersegurança. A principal conclusão? O cibercrime está prestes a ficar ainda mais caótico. Como se computadores, smartphones, routers, televisores e a míriade de gadgets inteligentes que tem lá por casa não representassem já várias possíveis portas de entrada para um atacante, os criminosos começam a olhar para outras tecnologias para conseguirem aquilo que procuram.

Pense nos robôs, por exemplo. O cenário de termos robôs a ajudarem-nos em tarefas do dia-a-dia, tal como vemos em livros, séries e filmes de ficção científica, ainda está longe de ser concretizado, mas já existem casos esporádicos de robôs que estão a ser usados para tarefas de interação com os humanos. E por que razão isto dá que pensar? Tony Belpaeme, professor de robótica e sistemas cognitivos na Universidade de Ghent, na Bélgica, explica.

«Criamos robôs parecidos com humanos para maximizar o efeito de socialização», começou por sublinhar o investigador, que realizou experiências com robôs humanoides na área da segurança informática. Numa das experiências foi colocado um robô fora de um pórtico de segurança e que tinha como objetivo passar para o lado de “dentro” de uma empresa. À medida que os funcionários iam chegando, deparavam-se com o humanoide. Conseguiria convencer alguém a deixá-lo passar? Segundo o estudo da Universidade de Ghent, 40% das pessoas ignoraram o robô, 20% perguntaram-lhe o que estava ali a fazer e os restantes 40% deixaram-no entrar sem qualquer questão.

E eis que tudo fica mais interessante: quando colocaram um autocolante de uma pizaria e uma caixa nas mãos do robô, a taxa de sucesso para entrar no edifício foi de 100% – “invasão” bem sucedida.

Numa outra experiência, colocaram robôs a falar com pessoas com o objetivo de extrair informações pessoais que pudessem servir de ponto de partida para saber a palavra-passe desses utilizadores. «Em menos de cinco minutos, com todas as pessoas, conseguiram extrair cinco informações pessoais. As pessoas assumem que os robôs são sistemas fechados, mas isso não acontece, os robôs são equipamentos conectados, são detidos por alguém», lembrou Tony Belpaeme.

Dmitry Galov, da Kasperksy, acredita que à medida que os robôs ficam mais democratizados, também vão ser explorados para táticas de engenheria social, tal como nos exemplos descritos. Mas se o “perigo” dos robôs, enquanto pontos de ataques informáticos, ainda parece estar a vários anos de distância, há outros novos perigos que prometem deixar muitos utilizadores vulneráveis.

Será que é mesmo verdade?

Recentemente uma notícia da publicação The Wall Street Journal foi replicada um pouco por todo o mundo: uma empresa britânica foi alvo de um roubo equivalente a 220 mil euros. Como? O atacante criou uma versão sintética da voz do diretor executivo (CEO) do grupo e deu instruções ao diretor da empresa britânica para que a transferência do dinheiro fosse feita.

A criação de voz falsa, a partir de dados recolhidos de diferentes fontes, encaixa-se dentro de um fenómeno maior: o dos chamados deepfakes. Os deepfakes são vídeos criados por sistemas de inteligência artificial, a partir de grandes bases de dados de imagens, que mostram alguém a dizer ou a fazer algo que nunca disse ou fez e com um intuito malicioso.

«Se as pessoas que fazem estes víudeos conseguirem recolher dados suficienets, conseguem fazer-se passar por ti», disse David Jacoby, também da Kaspersky, no evento em Lisboa. «[Os deepfakes] Vão permitir esquemas de phishing em esteróides», acrescentou o especialista. «A engenharia social é o truque mais antigo do livro. Todos estes crimes vão passar ao próximo nível, já não vai ser apenas o email do Viagra. E isto vai ser personalizado para ti. Como vais saber que é falso?», questionou.

«Gerar dados falsos, como imagens e vídeos, pode ser usado para influenciar as pessoas de uma forma negativa», considera por seu lado Marco Preuss, líder de investigação da Kaspersky na Europa, em entrevista à Exame Informática. «Num futuro próximo vai tornar-se mais difícil identificar estas falsificações. Isto é um grande risco e vai ser muito difícil saber onde é que isto nos vai levar. Porque no futuro vais sempre fazer a questão “isto é mesmo verdadeiro, o que vi e ouvi?”. Porque muitas das coisas podem ter sido falsamente geradas por um grupo com um determinado interesse», acrescentou.

Segundo um relatório da empresa holandesa Deeptrace, 96% dos vídeos deepfakes atualmente disponíveis online estão ligados ao mundo da pornografia. Mas isso não deve ser motivo para que o problema não seja levado como uma ameaça séria enquanto nova arma de cibercrime. «O que estamos a fazer neste momento é investigar todo este medo, estamos a seguir a tendência, estamos a olhar cuidadosamente para estes tópicos porque isto pode tornar-se grande no futuro e um problema muito comum.», disse ainda o alémão, líder de investigação da Kaspersky.

Este uso de técnicas de inteligência artificial para criar vídeos falsos, com o intuito de enganar alguém, está no entanto longe de ser o único problema ao “virar da esquina”. Apesar de a tecnológica russa ainda não ter qualquer prova ou indício de redes de cibercrime totalmente automatizadas, esta acabará por ser uma realidade quase inevitável.

«Os cibercriminosos sempre tentaram investir o mínimo possível para fazer o máximo de dinheiro possível. Eles estão a usar todas as técnicas comuns que conseguem para automatizar os ataques. Um cibercriminoso não é sempre uma pessoa com conhecimentos técnicos, isso é uma assunção errada. Muitas destas pessoas são não-técnicas, simplesmente compram algumas tecnologias no submundo da internet e fazem as suas operações», conta Marco Preuss.

Ou seja, da mesma forma que já existem ferramentas que permitem fazer deepfakes de forma relativamente simples, o mesmo poderá acontecer assim que as redes automatizadas de disseminação de malware surgirem. «Se existir, algum dia, uma técnica muito fácil de usar e fiável em termos de inteligência artificial para ajudar os criminosos a fazerem ataques, então é muito provável que venha a ser usada. É o senso comum das aprendizagens que temos feito com base no passado», acrescentou ainda o investigador.

Segundo Marco Preuss, falta literacia digital e de segurança, falta maior rigor no desenho dos produtos tendo a segurança como um dos pontos de partida e falta maior colaboração e partilha de informação a nível internacional.

«Penso que precisamos de encarar a realidade de que o mundo não está separado por países e em pessoas a viverem dentro de fronteiras: a internet é global, a comunicação é global, só precisamos de encarar a realidade e trabalhar juntos para assegurar que colocamos mais poder e segurança nesta rede global, em vez de desistirmos dela.»